Alors que les sensations de chaud et de froid sont un élément essentiel de l'expérience humaine, mesurer avec précision les températures a occupé bien des esprits savants. Nous ne savons pas bien si les Grecs anciens ou les Chinois possédaient un moyen de mesurer la température, mais toujours est-il que l'histoire des capteurs de température commence à s'écrire à la Renaissance.

Pourquoi effectuer des mesures ?

Robert Hooke

Robert Hooke

Ole Roemer

Ole Roemer

La chaleur est une mesure de l'énergie dans un corps ou un matériau, plus l'énergie est forte, plus la chaleur est importante. Cependant, contrairement aux propriétés physiques de la masse et de la longueur, elle est difficile à mesurer. La plupart des méthodes, indirectes, se basaient sur l'observation de l'effet de la chaleur sur un objet et on en déduisait la température.

La création d'une échelle de mesure a aussi constitué un obstacle de taille. En 1664, Robert Hooke a proposé d'utiliser le zéro comme point de congélation de l'eau, et de mesurer les températures à partir de ce point. À la même époque, Ole Roemer a déterminé deux points fixes, puis une interpolation entre ces deux points. Les points choisis étaient le point de congélation de Hooke et le point d'ébullition de l'eau. Restait à comprendre comment les éléments parvenaient à l'état de chaleur ou de froid.

Cette énigme a été résolue par des scientifiques, dont Gay-Lussac, qui ont travaillé sur les lois du gaz. Au cours du 19e siècle, en recherchant les effets de la température sur le gaz à une pression constante, ils ont observé que le volume augmente de 1/267 par degré Celsius (le rapport a ensuite été révisé à 1/273,15). Le concept du zéro absolu à moins 273,15 C a ainsi été défini.

Observation de la dilatation : liquides et bimétaux

La conception par Gallilé d'un appareil affichant les changements de températures remonte aux alentours de 1592. Il s'est fondé sur la contraction de l'air dans un récipient pour dresser une colonne d'eau dont la hauteur indique le degré de refroidissement. Cependant, l'influence exercée par la pression de l'air est très forte et cet appareil ne constituait pas une découverte majeure.

Le thermomètre moderne a été inventé en 1612 dans l'Italie actuelle par Santorio Santorii. Il a scellé un tube en verre contenant du liquide et a observé le déplacement du liquide pendant sa dilatation. Une échelle sur le tube a facilité la lecture de l'évolution mais le système ne comptait pas d'unités précises.

Collaboration entre Roemer et Daniel Gabriel Fahrenheit. Daniel Gabriel Fahrenheit a commencé à fabriquer des thermomètres avec de l'alcool et du mercure. Le mercure est idéal car il réagit linéairement aux changements de températures sur une plage étendue. Sa toxicité a toutefois imposé une restriction de son utilisation. D'autres liquides remplacent maintenant le mercure. Le thermomètre liquide est largement répandu bien qu'il soit important de contrôler la profondeur d'immersion du bulbe. L'emploi d'un capteur thermométrique garantit un bon transfert thermique.

Le capteur de température bimétallique a été inventé à la fin du 19e siècle. Il se fonde sur l'expansion différentielle de deux bandes métalliques reliées entre elles. Les changements de température créent un cintrage qui active un thermostat ou une jauge similaire aux appareils installés dans les grills au gaz. La précision est faible, plus ou moins 2 degrés environ, mais ces capteurs sont économiques et comptent de nombreuses applications.

Galileo Galilei

Galileo Galilei

Santorio Santorii

Santorio Santorii

Burial Plaque of Daniel Gabriel Fahrenheit

Burial Plaque of Daniel Gabriel Fahrenheit

Effets thermoélectriques

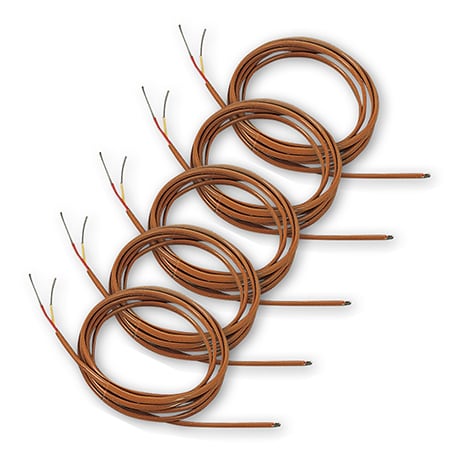

Au début du 19e siècle, l'électricité a passionné de nombreux chercheurs qui ont rapidement découvert que la résistance et la conductivité des métaux étaient variables. En 1821, Thomas Johann Seebeck a déterminé qu'une tension se crée lorsque les extrémités de métaux différents sont jointes et placées à des températures différentes. Peltier a découvert que cet effet du thermocouple est réversible et peut servir pour le refroidissement.

La même année, Humphrey Davey démontra que la résistivité électrique d'un métal est associée à la température. Cinq ans plus tard, Becquerel a proposé de mesurer la température au moyen d'un thermocouple platine-platine mais il fallut attendre 1829 pour que Leopoldi Nobili crée l'appareil.

La platine est aussi utilisée dans le détecteur de température à résistance inventé en 1932 par C.H. Meyers. Ce détecteur mesure la résistance électrique d'une longueur d'un fil de platine et est largement considéré comme l'instrument le plus précis.

Les RTD à fil sont fragiles par nature et non adaptés aux applications industrielles. Les RTD à film, moins précis mais plus robustes, ont connu un important développement au cours des dernières années.

Le 20e siècle a aussi été marqué par l'invention d'appareils de mesure de la température à semi-conducteurs. Ils réagissent avec précision aux changements de températures mais ont, jusqu'à récemment, manqué de linéarité.

Rayonnement thermique

Samuel Langley

Samuel Langley

William Herschel

William Herschel

Les métaux très chauds et fondus diffusent de la chaleur et une lumière visible. Ils rayonnent de la chaleur à basses températures mais à des longueurs d'onde plus importantes. L'astronome anglais, William Herschel, a été le premier à reconnaître, aux alentours de 1800 que cette lumière "sombre" ou infrarouge générait de la chaleur. En collaborant avec son compatriote Melloni, Nobili a pu détecter cette énergie rayonnée en reliant les thermocouples en série pour constituer une pile thermoélectrique.

Le bolomètre a ensuite été découvert en 1878. Inventé par l'Américain Samuel Langley, le bolomètre est la disposition de deux bandes de platine, dont une est noircie, selon une structure en pont de Wheatstone. Le chauffage par rayonnement infrarouge entraîna un changement mesurable de la résistance.

Les bolomètres sont sensibles à la lumière infrarouge dans une vaste plage de longueurs d'ondes. Par contraste, les appareils de type détecteur de photons, conçus dès les années 40, ne réagissent aux infrarouges que dans une longueur d'ondes limitée. Les détecteurs au sulfure de plomb sont sensibles aux longueurs d'ondes jusqu'à 3 microns. La découverte de l'alliage ternaire HgCdTe en 1959 a ensuite ouvert la voie aux détecteurs adaptés à des longueurs d'ondes spécifiques.

Aujourd'hui, les pyromètres infrarouges bon marché sont largement répandus et les applications se multiplient pour les caméras thermiques dont le prix chute.

Échelles de températures

Lord Kelvin

Lord Kelvin

Anders Celsius

Anders Celsius

Fahrenheit a ressenti le besoin d'élaborer une échelle de températures lorsqu'il fabriquait des thermomètres. Il a défini le point de congélation de l'eau salée à 30 degrés F (0 °C) et son point d'ébullition à 180 degrés F (82 °C) plus haut. Il a ainsi décidé d'utiliser de l'eau pure, qui gèle à des températures légèrement plus élevées, soit un point de congélation à 32 °F (0 °C) et un point d'ébullition à 212 °F (100 °C).

Un quart de siècle plus tard, Anders Celsius a proposé une échelle de 0 à 100, qui aujourd'hui porte son nom. Constatant les avantages d'un point fixe à une extrémité de l'échelle, William Thomson, connu ensuite sous le nom de Lord Kevin, a proposé d'utiliser le zéro absou comme point de départ du système Celsius. C'est ainsi qu'a été conçue l'échelle Kelvin, employée dans le domaine scientifique.

Les échelles de mesure de la température sont aujourd'hui définies dans un document dénommé Échelle internationale de température de 1990 ou ITS- 90. Une copie est disponible pour les lecteurs soucieux d'approfondir leurs connaissances en unités de mesure.